Darwin nella macchina

#20: Una deviazione sulle origini della coscienza e su cosa un verme del Cambriano può dirci sulle intelligenze artificiali

Questa è Demons Dance Alone, una newsletter che parla di storia della vita, biodiversità, estinzioni, tempo profondo, Antropocene, evoluzione e temi connessi. Esce a intervalli irregolari; circa una volta al mese ma volte più spesso e a volte meno. Per iscriverti e supportarmi (ogni abbonamento mi permette di scriverne di più e meglio!), usa il pulsante sotto.

Oggi qui si parla di un altro tipo di demone: quello interno a ciascuno di noi, e che illumina il mondo. Si parla, in altre parole, di AI e coscienza, due temi che non sembrano entrarci molto con i demoni che danzano soli nel tempo profondo o presente. Ma c’è un legame, come vedremo.

The ghost in the shell

Per motivi che, per pietà, non voglio ricordare, sui social nei giorni scorsi si è parlato di nuovo parecchio della coscienza dei large language models, i modelli linguistici AI come Claude o ChatGPT. Non mi sottraggo alla scelta incosciente di dire la mia sul tema.

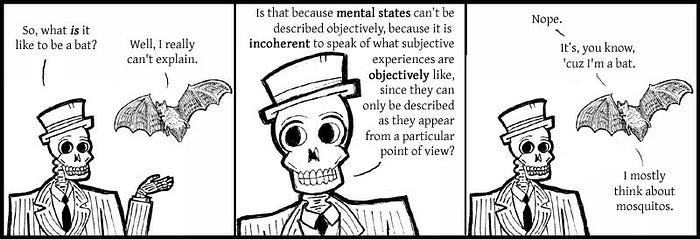

Parto da questo post dove il neuroscienziato Giorgio Gilestro afferma una verità: qualsiasi affermazione apodittica, positiva o negativa, sullo status di coscienza di un’AI (o del Papa, o di un koala, o di un comodino) di per sé è un azzardo. La verità è che la coscienza, nel senso di “com’è-essere-quella-cosa”, di esperienza interna, di awareness, chiamatela come volete, è un dato di per sé per sempre precluso alla ricerca empirica. Non esiste alcun esperimento possibile che, dall’esterno mi permetta di controllare la percezione dall’interno, perché per definizione la coscienza è l’esperienza interna e solo quella. Non posso entrare nella testa di un pipistrello e capire a mia volta com’è essere un pipistrello. “All we can ever know about are the portraits of each other inside our own skulls.” (Greg Egan)

Questo significa (a meno che non mi sfugga qualcosa di fondamentale) che non c’è speranza di ottenere una teoria scientificamente solida della coscienza. Possiamo cercare dei correlati, ovvero dei segni oggettivi di qualcosa che corrisponde all’esperienza che un soggetto riporta come cosciente e/o a comportamenti che interpretiamo come coscienti, ma non potremo mai verificarlo oltre ogni dubbio. Tantomeno possiamo verificare come è quell’esperienza cosciente. Una risposta scientificamente oggettiva, misurabile, alla famosa domanda che ci siamo posti da piccoli “ma tu vedi il rosso come lo vedo io?” non c’è.1

Premesso quindi che le fondamenta sono friabili, possiamo farci delle domande basate su assunti plausibili. Gli unici esseri di cui abbiamo forti sospetti di coscienza sono dotati di cervello, e il cervello è direttamente coinvolto negli stati di coscienza. È quindi plausibile che la coscienza sia un fenomeno materiale del cervello e non una qualche mistica proprietà metafisica.2 È plausibile quindi che perlomeno i cervelli simili al mio siano coscienti in modo simile a me.

I cervelli sono organi, sono un ente biologico. E come ci insegna qualcuno, nulla ha senso in biologia se non alla luce dell’evoluzione. La domanda essenziale per affrontare il problema della coscienza è quindi: perché e come si è evoluta la coscienza? Da questa domanda, che si era posto già Darwin, come vedremo, potremmo trarre indicazioni utili per il dibattito sulla coscienza delle intelligenze artificiali.

Dal caos, un mondo

Lo studio evolutivo della coscienza è una disciplina a sé, e non oso nemmeno sfiorarne la superficie. Qui mi basta accennare a una teoria a mo’ di esempio, che per inciso trovo una delle più convincenti, quella proposta nel 2005 da Björn Merker. A prescindere da quanto convinca anche voi, è un buon esempio di che aspetto ha una teoria biologica e evolutiva della coscienza.

La domanda da cui parte Merker è: cosa manca nella nostra esperienza cosciente? A livello sensoriale, moltissimo. Per esempio non abbiamo praticamente coscienza della propriocezione: quando stiamo in piedi, il corpo esegue un calcolo continuo e raffinatissimo con cui compensa i movimenti dei nostri muscoli per tenerci in equilibrio, ma di tutte queste compensazioni non siamo minimamente consapevoli, né possiamo esserlo (perlomeno finché non ci troviamo a voler camminare su di un filo).

Ora, non c’è nessun motivo metafisico per cui non dovremmo essere coscienti della propriocezione: non vedo come una prospettiva, che so, panpsichista possa spiegare che i colori sì ma la propriocezione no. Ma c’è un ottimo motivo pratico. Cosa accadrebbe se di colpo fossimo coscienti di ogni microscopica correzione dei nostri movimenti oculari, di ogni minimo accomodamento della pupilla? Di ogni respiro, di ogni battito del cuore? Probabilmente, saremmo di fatto quasi ciechi, ridotti all’impotenza da un sovraccarico sensoriale completamente inutile.

La coscienza secondo Merker è un filtro. Il cervello setaccia un’enorme serie di dati che arrivano di continuo dai sensi interni ed esterni. Da questi, seleziona quelli che si possono gestire come monitoraggio automatico da quelli vanno valutati per prendere decisioni. Questi ultimi di per sé, separatemente, formano un flusso incoerente e continuo di dati di ogni tipo: visivi, uditivi, tattili, eccetera. Per renderli intellegibili vengono integrati in una simulazione che appare come un insieme coerente: il mondo. Lo stesso vale per le emozioni, le sensazioni interne: paura, fame, dolore, piacere. Come quelle esterne, queste sensazioni ci servono a prendere decisioni sul mondo e quindi vanno integrate nel quadro complessivo e interpretate assieme al resto.

Quando le sensazioni utili interne ed esterne sono state integrate, il cervello ha davanti a sé un quadro astratto ma interpretabile, confrontabile di volta in volta con esperienze passate, e può decidere di conseguenza. In questo senso i qualia, il “com’è questa esperienza” (es. la “rossità” del rosso), sono rappresentazioni immediate che ci permettono di interpretare rapidamente gli input sensoriali. Invece di dover interpretare uno a uno i livelli di luce che ricevono i miei fotorecettori, condenso l’informazione nel quale di un colore, immediatamente interpretabile. La coscienza è il modo in cui distilliamo un mondo dal caos dei sensi.

Una luce nel Cambriano

Quando si evolve la coscienza, dunque, secondo Merker? Nel momento in cui si evolvono animali attivi nel loro ambiente. Immaginiamo un piccolo animale nei mari del primissimo Cambriano. È poco più di un vermetto: ma ha occhi ed è capace di vedere, ha un tatto e sente l’acqua o la sabbia sulla pelle, sente gli odori sparsi nell’acqua. Il nostro vermetto, semplice com’è, è già immerso in un flusso continuo di dati sensoriali che cambia da un attimo all’altro. E questo flusso cambia di continuo man mano che il vermetto si muove. A ogni movimento della testa cambia completamente ciò che ha davanti agli occhi, per esempio. Per poter raccapezzarsi, non può interpretare ciò che vede fotogramma per fotogramma. Deve poter capire che il sasso intorno a cui nuota è sempre lo stesso sasso anche se, a ogni colpo di coda, questo traballa e cambia posizione nel suo campo visivo. Deve quindi inserirlo in una struttura coerente, assieme a ciò che annusa, a ciò che sente sulla pelle, alla temperatura dell’acqua, ai suoi movimenti, in cui tutto questo possa condensarsi nel concetto: sto girando intorno a questo sasso.

La coscienza dunque è la risposta concreta dell’evoluzione al problema di avere un corpo in costante movimento, con un flusso sensoriale complesso, e la necessità di prendere decisioni rapidamente. È tutto qui.

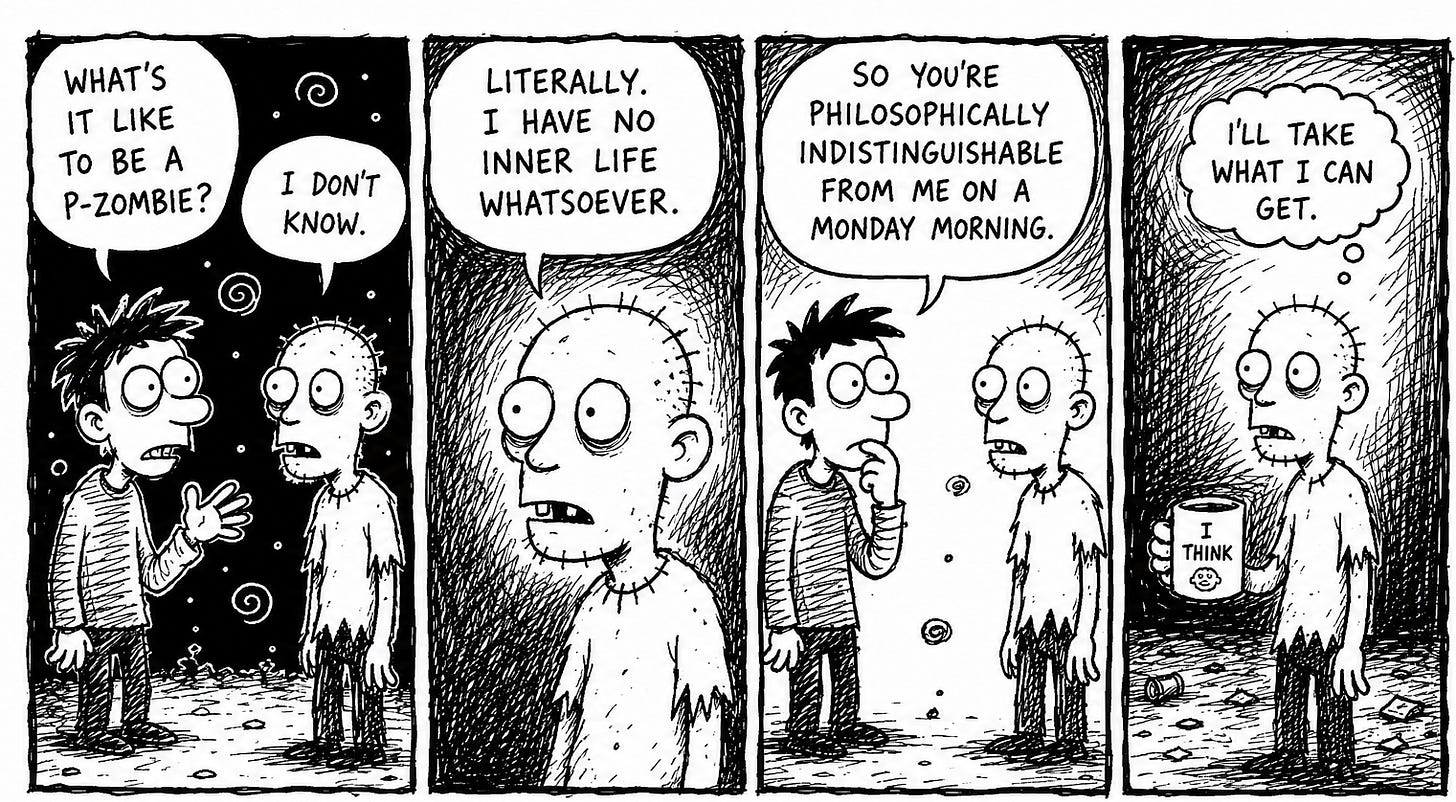

A questo punto è lecito obiettare: come mai però si “accende la luce” nella stanza? Non si potrebbe avere tutta questa integrazione senza consapevolezza? È possibile che l’esperienza cosciente sia semplicemente quello che accade nel momento in cui un cervello genera un quadro coerente del mondo in questi termini. In altre parole: l’esperienza cosciente è intrinseca a quel tipo di integrazione, ne è il prodotto inevitabile. Se così fosse, allora non possono esistere p-zombie.

Se invece insistiamo che si possa avere questa integrazione senza che ci sia una lucina interna (anche se confesso che mi è difficile pensare a come, ma questo magari è un mio limite) il problema ultimo resta insoluto. Come abbiamo detto all’inizio, l’esperienza interna è per definizione inaccessibile a ogni indagine empirica (se non su noi stessi). Resta il fatto che questa luce interna sembra stranamente selettiva su quanto ci serve avere a portata di mano e quanto no, e su come lo organizza. Quale che sia il meccanismo che “accende la luce” noi, su questo pianeta, da seicento milioni di anni, è plausibile che ci siamo evoluti lungo la strada che, per creare un mondo intellegibile, finisce per accendere questa luce sui dati che gli servono. Nulla esclude, inoltre, che altrove nell’Universo, o nei nostri laboratori di robotica, esistano enti che hanno risolto questo problema senza bisogno di un’esperienza cosciente: è possibile che la coscienza non sia l’unica soluzione che risolve il problema dell’integrazione sensoriale.

A luce spenta

Uno dei pregi della teoria di Merker è che separa la coscienza dalle facoltà cognitive. Il nostro vermetto non ha bisogno di essere particolarmente intelligente per aver bisogno di un quadro coerente del mondo. Viceversa, noi sappiamo che possiamo elaborare dati e informazioni in modo complesso senza esserne coscienti. Quando dormiamo, per esempio, interpretiamo il flusso di suoni in modo affatto banale: il fruscìo del lenzuolo sulle orecchie non ci sveglia, la flebile voce di nostro figlio che ci chiama ci sveglia immediatamente.

Pensiamo a cosa significa in questo contesto. Quando dormiamo non dobbiamo prendere costantemente decisioni su cosa fare: è il momento in cui il nostro cervello dice “adesso non devi fare niente se non riposare”. Possiamo quindi benissimo non essere coscienti e non lo siamo. Ma nel momento in cui il bambino chiama maaaammmaaaa papaaaaà allora c’è una situazione a cui dobbiamo reagire: dobbiamo alzarci, andare nella stanza del bambino, vedere se vuole un bicchiere d’acqua o se ha paura del buio. Ci serve di nuovo navigare il mondo con il moto e con i sensi; ci serve quel quadro integrato che è la coscienza. Ci svegliamo. Il fatto che esista una correlazione molto stretta tra awakeness (stato di veglia) e awareness (stato di consapevolezza) acquista immediatamente senso.

Servono ali per non volare?

A questo punto possiamo tornare alla questione originaria: le intelligenze artificiali sono o saranno coscienti? Nota bene, qui non parliamo di intelligenza. Se lo chiedete a me un LLM è intelligente, nel senso del test di Turing: agisce come ci aspettiamo da un agente intelligente, anche se è un’intelligenza diversa dalla nostra. L’intelligenza non è una percezione interiore, è una caratteristica che ha a che vedere con la risoluzione di classi generali di problemi. Ma un’AI come i LLM, non importa quanto intelligente, se non ha bisogno di creare un quadro coerente momento per momento del mondo che riceve dai sensi, non ha motivo di essere cosciente. E un LLM non ha dati sensoriali: non ha sensi. Tutto ciò che riceve in input sono parole, tutto ciò che fa è elaborarle e generarne di nuove. Si attiva quando riceve un prompt, torna in stand-by quando ha smesso di elaborarlo. Non ha un flusso di esperienza. Per gestire quell’input la coscienza, semplicemente, non gli serve.

Allo stesso modo, una pianta o una spugna non ha bisogno di essere cosciente. Non si muove, non deve integrare delle informazioni sensoriali in un quadro coerente, quindi con ogni probabilità non lo è (vedasi il volume di Marco Ferrari sul tema). Premetto subito che “non gli serve” non è una prova che non sia cosciente. Non possiamo saperlo; non potremo mai saperlo. Ma l’onere dell’argomento, a questo punto, è su chi vuole sostenere che un LLM sia cosciente: perché mai un ente che non ha bisogno di una coscienza né è stato programmato per averla dovrebbe averla? A che servono le ali a qualcosa che non ha mai avuto bisogno di volare?

Viceversa, altri tipi di AI potrebbero essere coscienti? Perché no. Tutto il nostro argomento non ha niente a che fare con una “unicità” dei cervelli biologici, ma con la loro funzione. Addestrando un robot che riceve dati sensoriali dal mondo ad agire al suo interno potrebbe emergere una forma di coscienza, perché la coscienza è quello che succede quando costruisci un quadro del mondo interno di questo tipo. Se è così, potremmo trovarci davanti al paradosso per cui un robottino poco più intelligente di un Roomba sia in realtà più vicino alla coscienza dei modelli linguistici con cui conversiamo.

In generale

Riassumiamo. Tutto quanto abbiamo detto vale nello specifico se accettiamo la teoria di Merker. Non siamo obbligati a farlo. Come ho accennato all’inizio, di teorie evolutive della coscienza ce ne sono parecchie e non è detto che dobbiate essere d’accordo con questa. A novembre 2025 è uscito un intero numero di Philosophical Transactions B con decine di punti di vista sull’argomento, per dire. Magari la coscienza ha più a che fare con l’essere specie sociali, o parte più dalla percezione degli stati interni che dei sensi esterni, fate voi. Non è mio compito convincervi di quella specifica teoria.

Il principio di fondo però resta lo stesso. Se la coscienza è qualcosa che ha una funzione evolutiva (e molto probabilmente lo è), il senso della sua funzione ed evoluzione è il riferimento che ci serve. Dal confronto con Darwin non sfuggono neppure le macchine.

Canzone di oggi

Rhys Chatham - An Angel Moves Too Fast To See (per 100 chitarre elettriche)

Qui si inserirebbe il famoso esperimento mentale noto come “la stanza di Mary”. La mia personale risposta è che non è possibile per Mary sapere tutto quello che c’è da sapere sul rosso. Ma non perché la coscienza abbia un di più metafisico: semplicemente, perché non abbiamo le parole per esprimere la sensazione del rosso, e quindi Mary non potrebbe leggerlo. E non abbiamo quelle parole perché quelle parole non possono esistere. Questo perché i qualia, non essendo condivisi, non possono essere parte del linguaggio: due parlanti non possono mettersi d’accordo sulle parole per descrivere la “rossità”. Non possiamo comunicare ciò che per definizione non è comunicabile; i libri di cui Mary avrebbe bisogno sono inconcepibili.

So che diversi filosofi non sono d’accordo; ma del resto in questo campo non esiste la verità infusa. Questo articolo esprime le mie opinioni.

Ho eliminato un mio commento perché sembrava scritto da un bot mentecatto, ogni tanto succede, abbi pazienza.